Backend.AI WebUI

GPU 활용, 운영의 장벽을 낮추는 인터페이스

수천 대의 GPU 서버를 하나의 관리포인트에서 운영해보세요.

Product Tour

WebUI의 화면을 직접 확인하세요

GPU 인프라 관리를 직관적으로 만드는 핵심 화면을 살펴보세요.

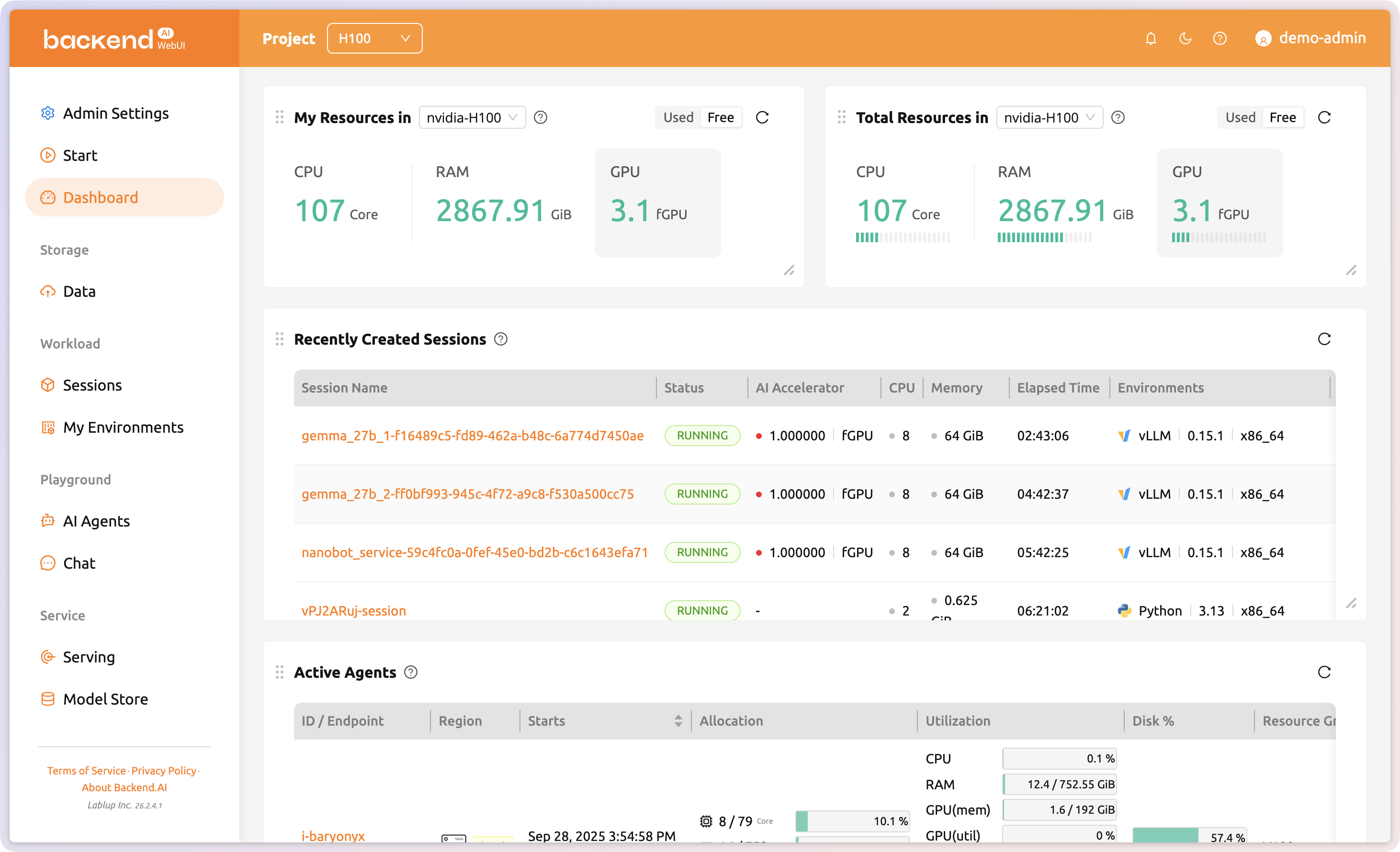

클러스터 상태를 한눈에

GPU 활용률, 나에게 할당된 자원, 전체 자원, 활성 에이전트 및 최근 생성 세션까지 다양한 정보를 하나의 페이지에서 한 눈에 살펴볼 수 있습니다.

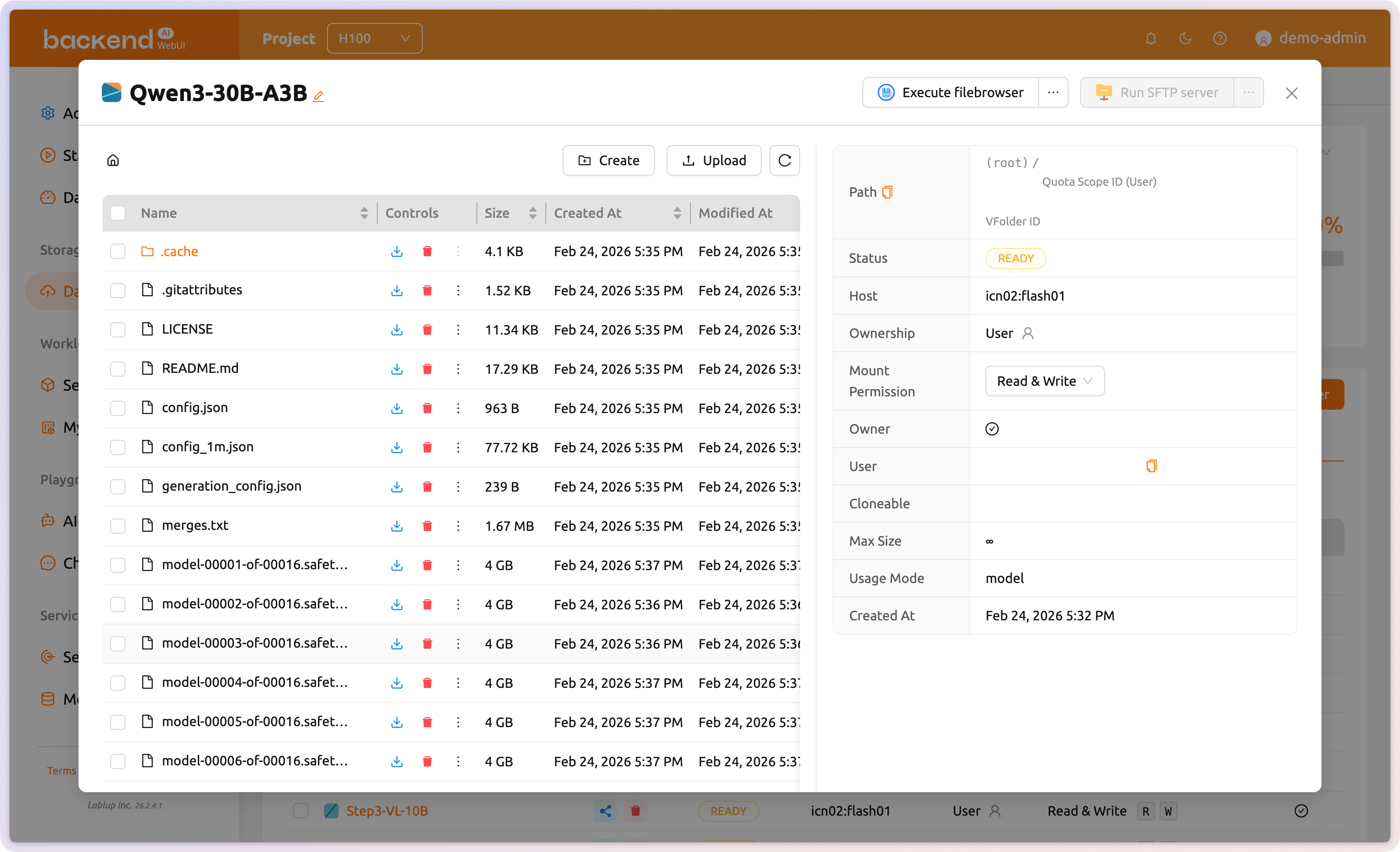

세션을 넘나드는 체계적인 데이터 관리

VFolder를 만들어 파일을 업로드하고, 체계적으로 관리하세요. 사용 방식도 원하는대로 지정할 수 있고, 데이터를 누구와 어떻게 공유할지 세밀한 종류와 권한 설정도 가능합니다.

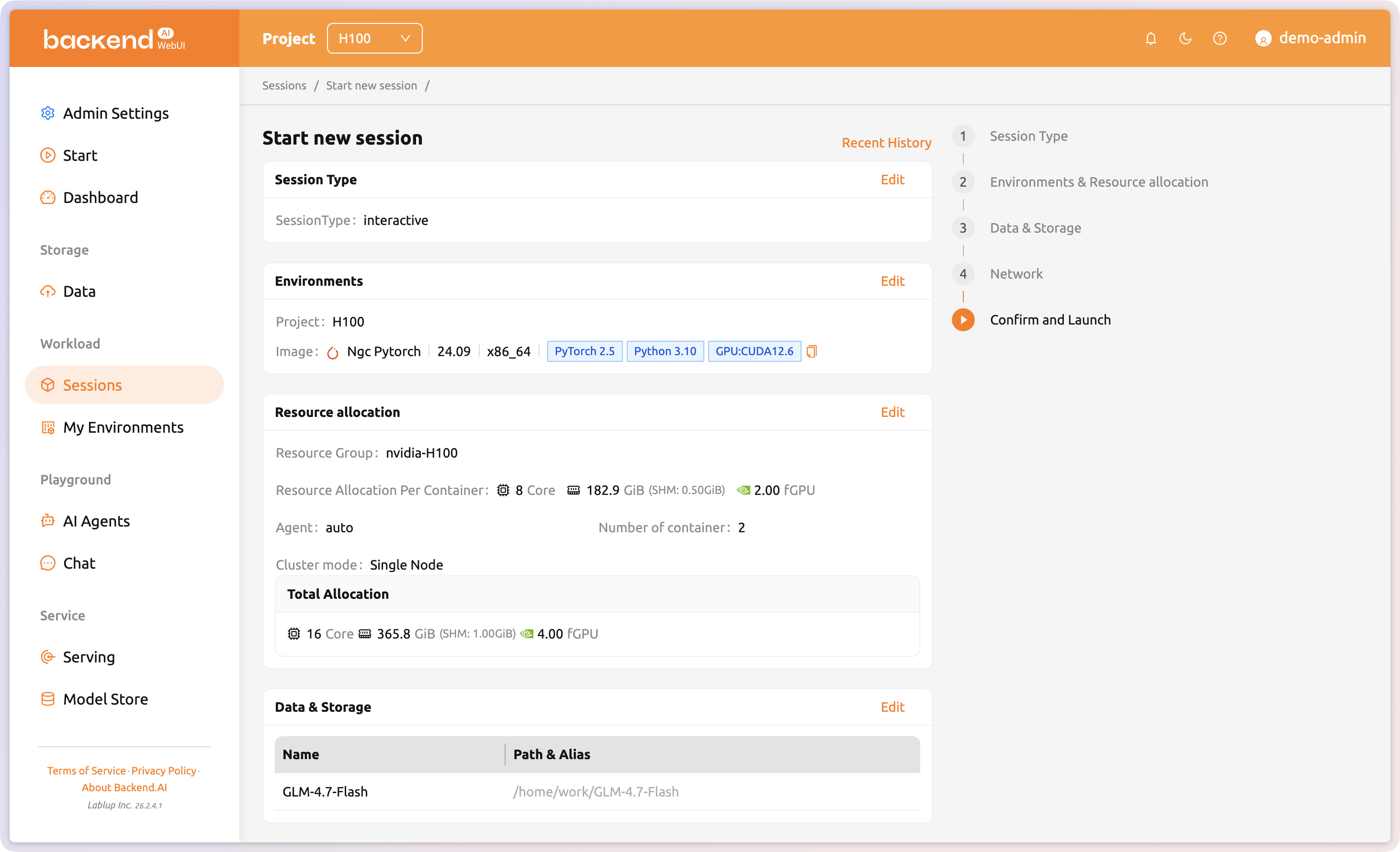

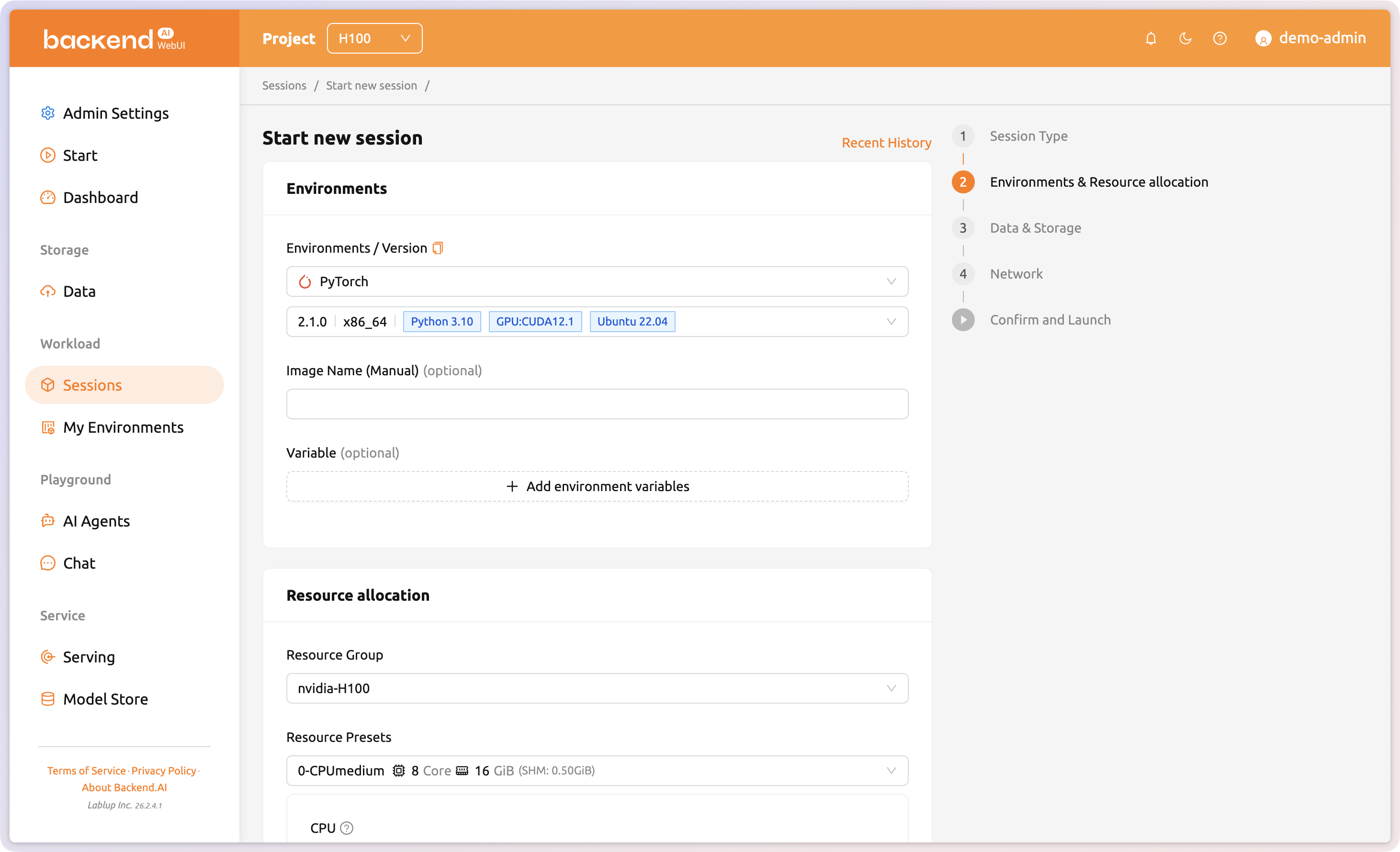

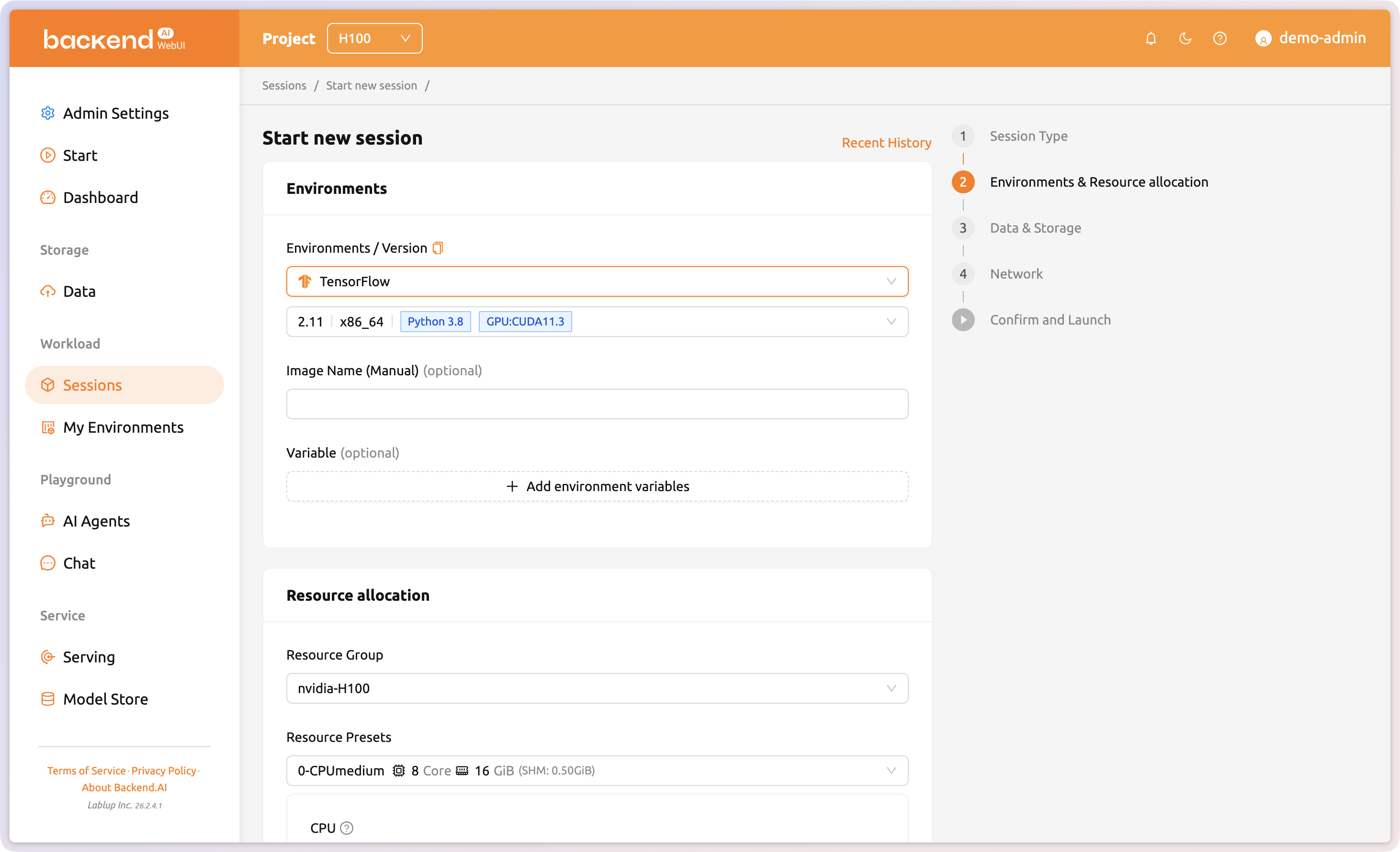

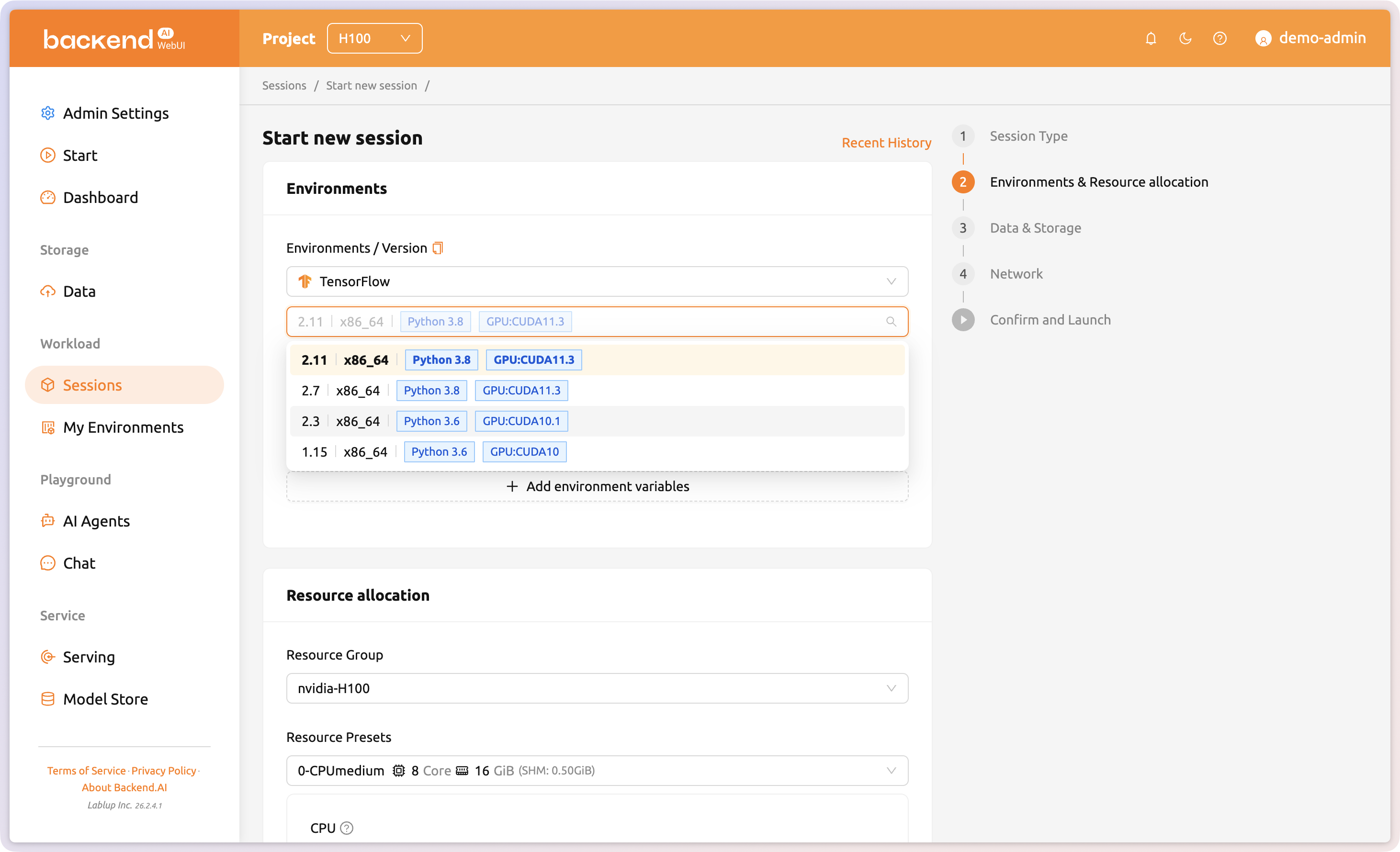

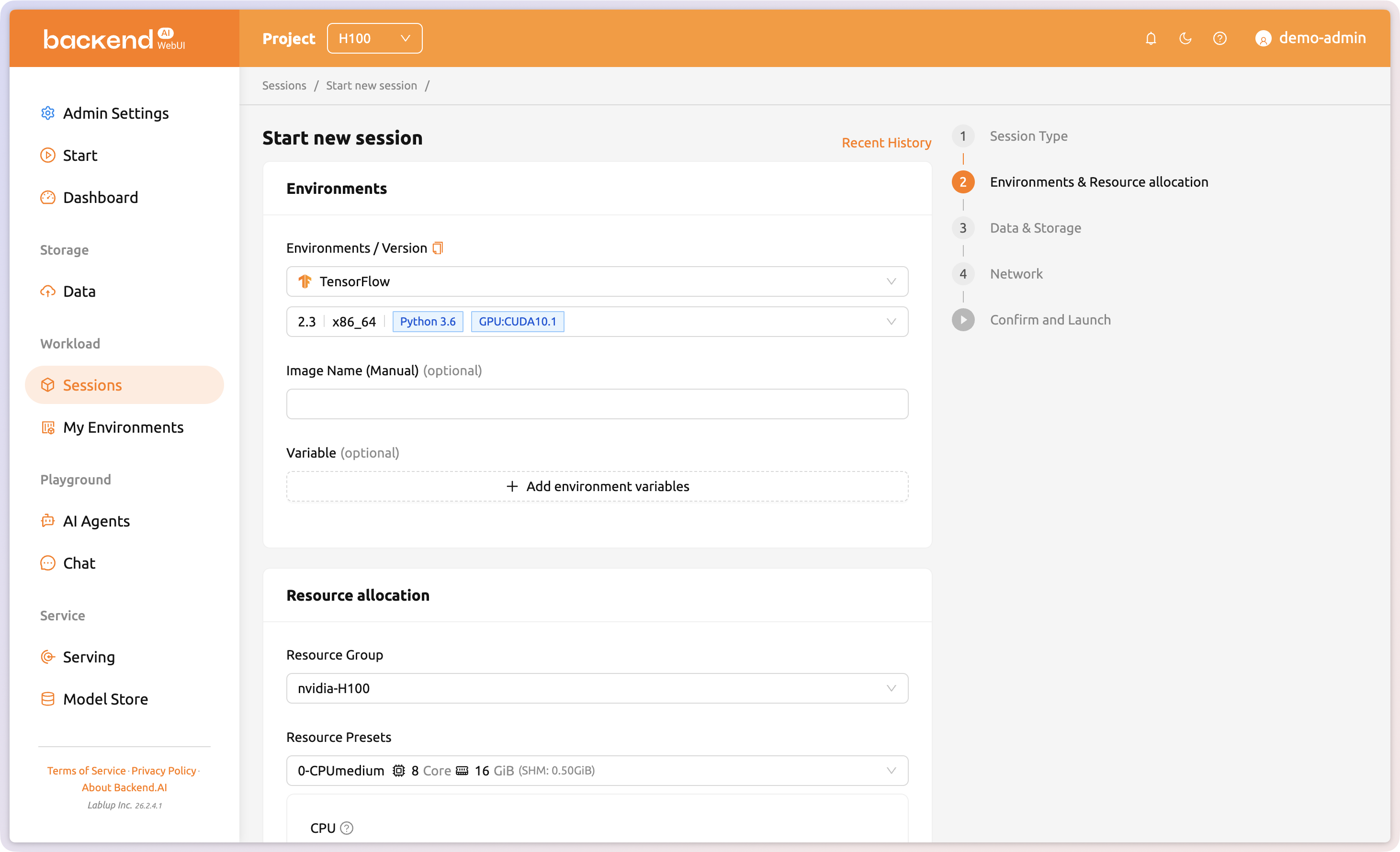

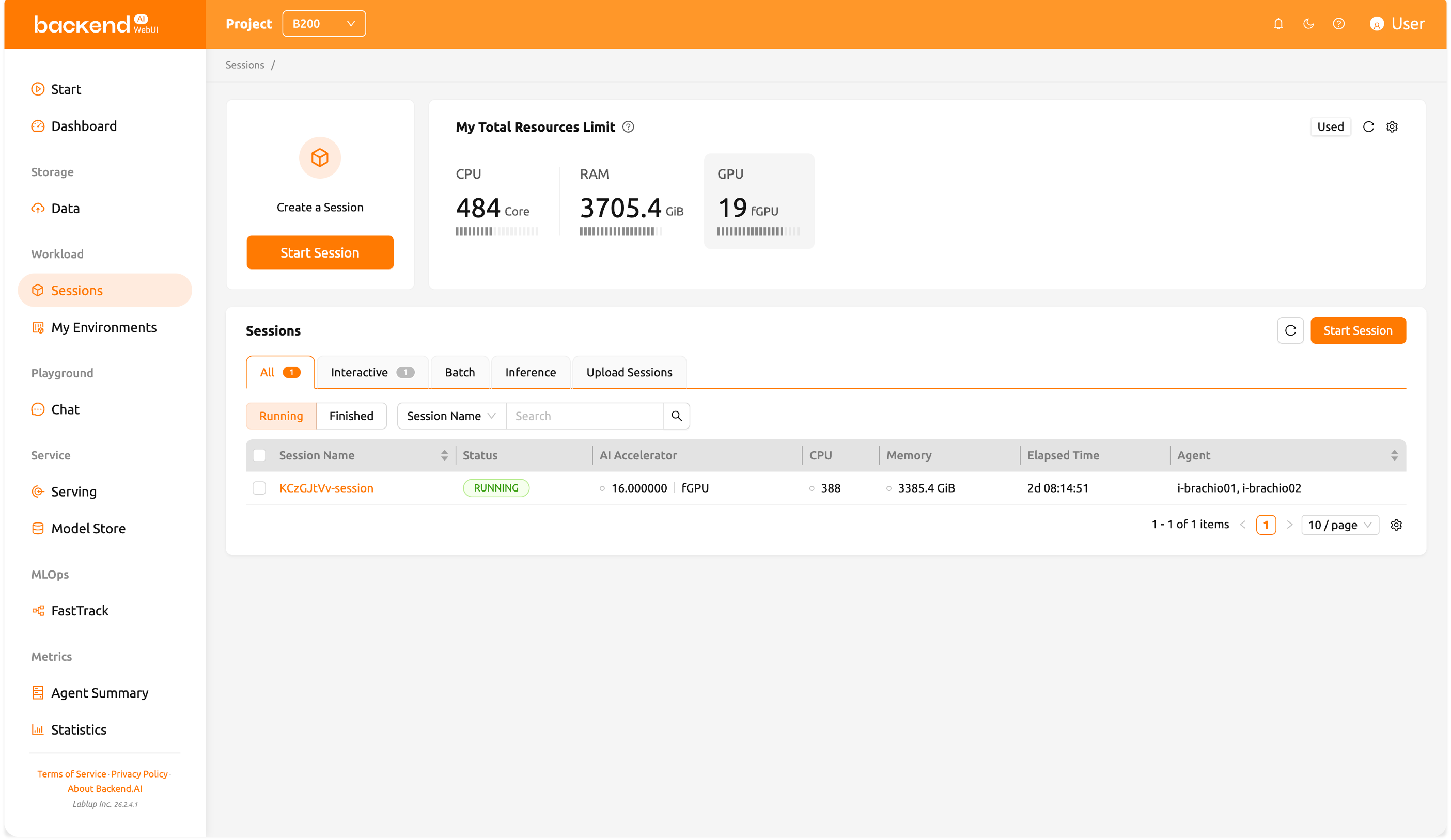

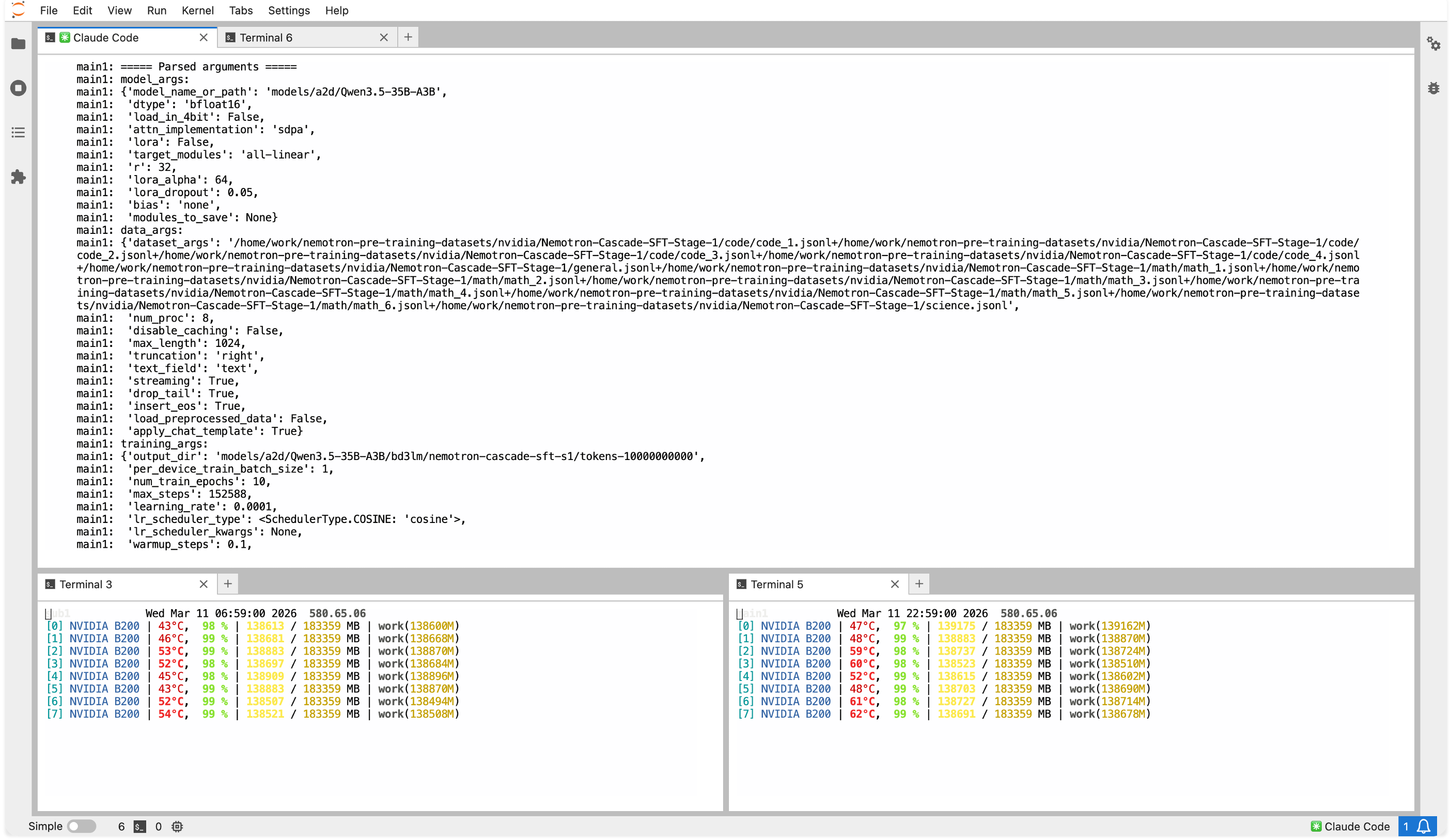

AI 워크로드 실행 및 관리

사용자가 모델 학습, 데이터 분석 등을 실행할 수 있는 독립적인 컴퓨팅 환경, 세션을 생성할 때 필요한 AI 가속기의 수, 메모리, 환경 이미지 등을 설정할 수 있습니다. 필요한 워크로드의 종류에 따라 Interactive, Batch, Inference 세션을 생성하여 활용할 수 있습니다.

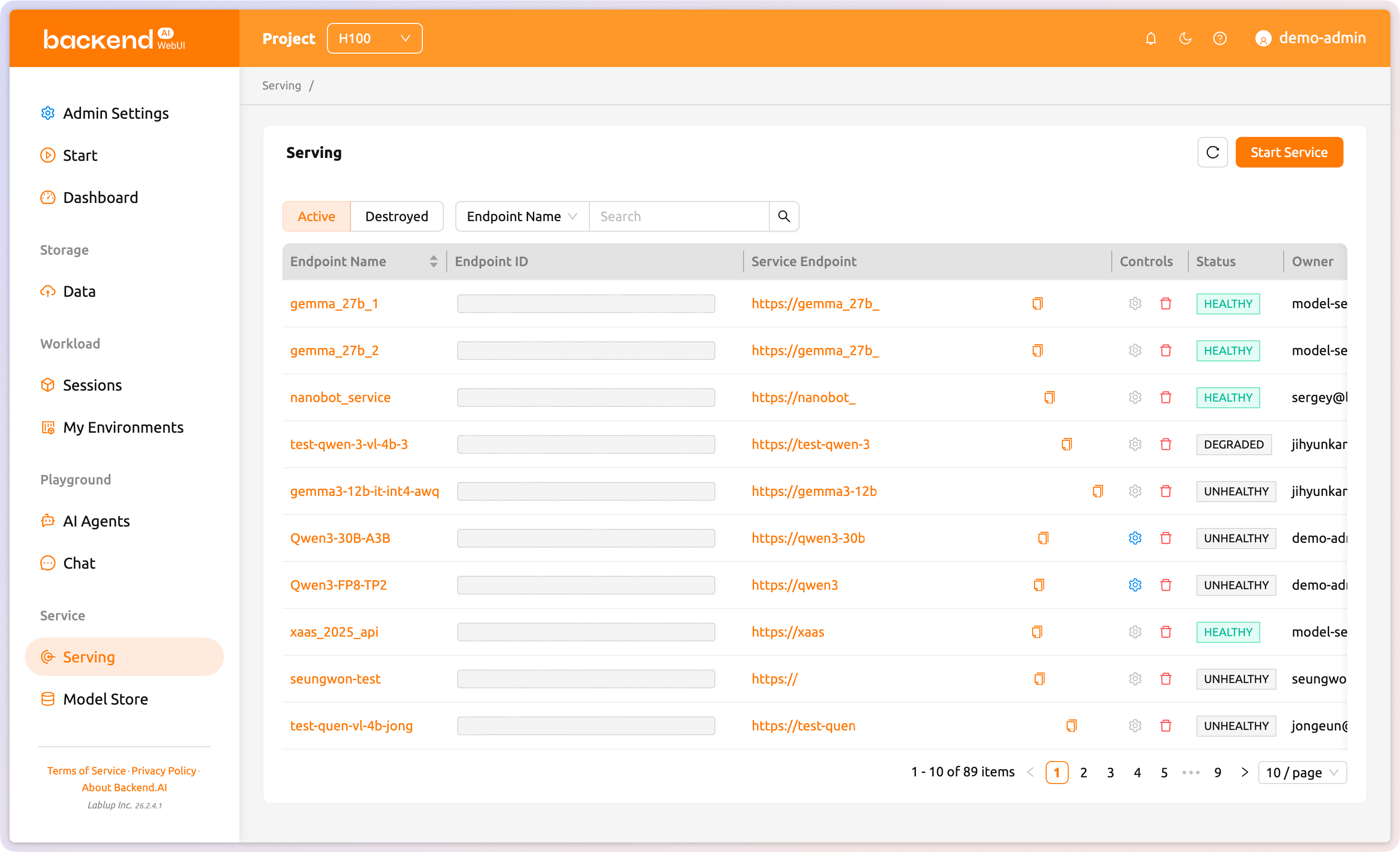

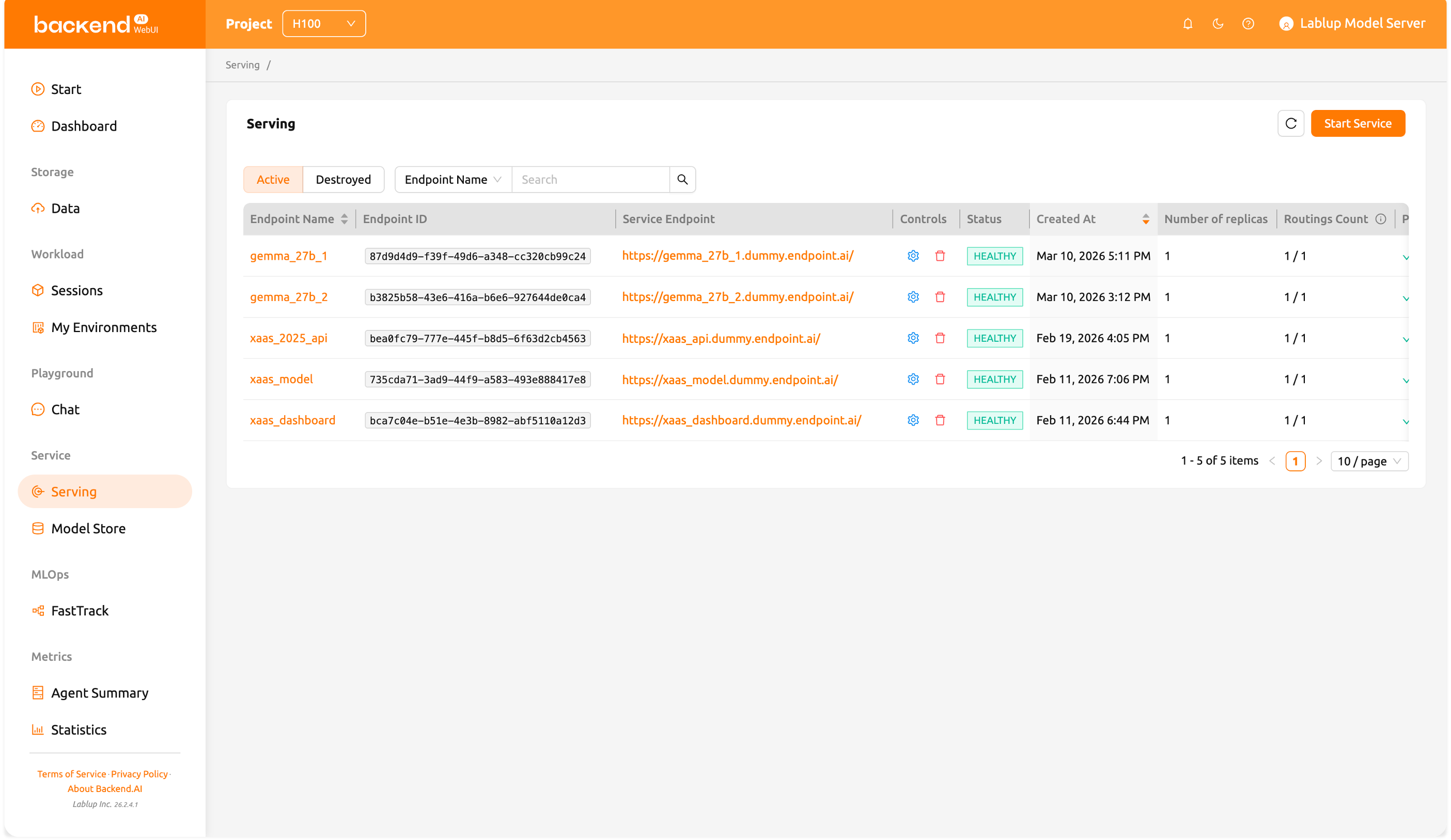

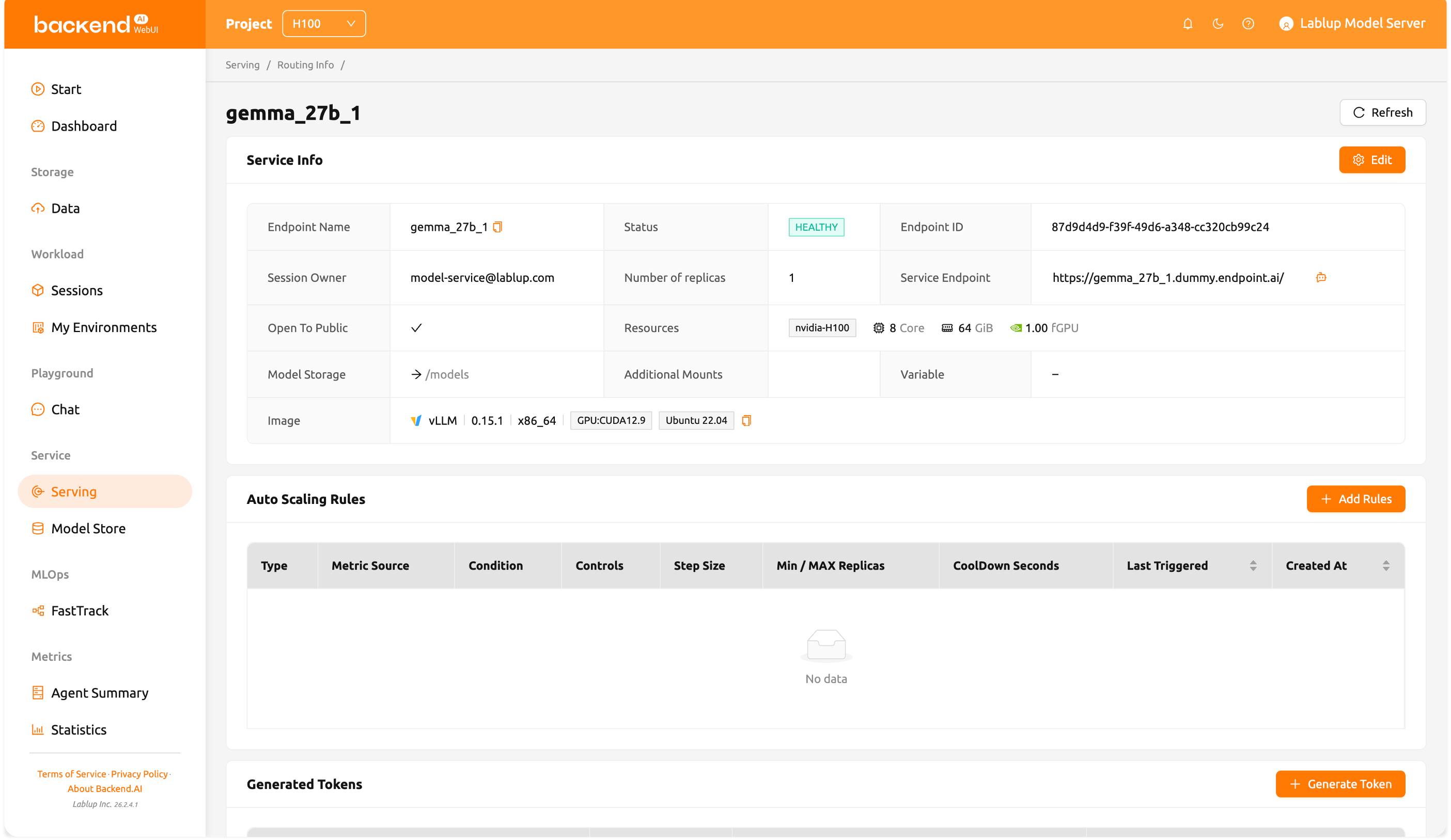

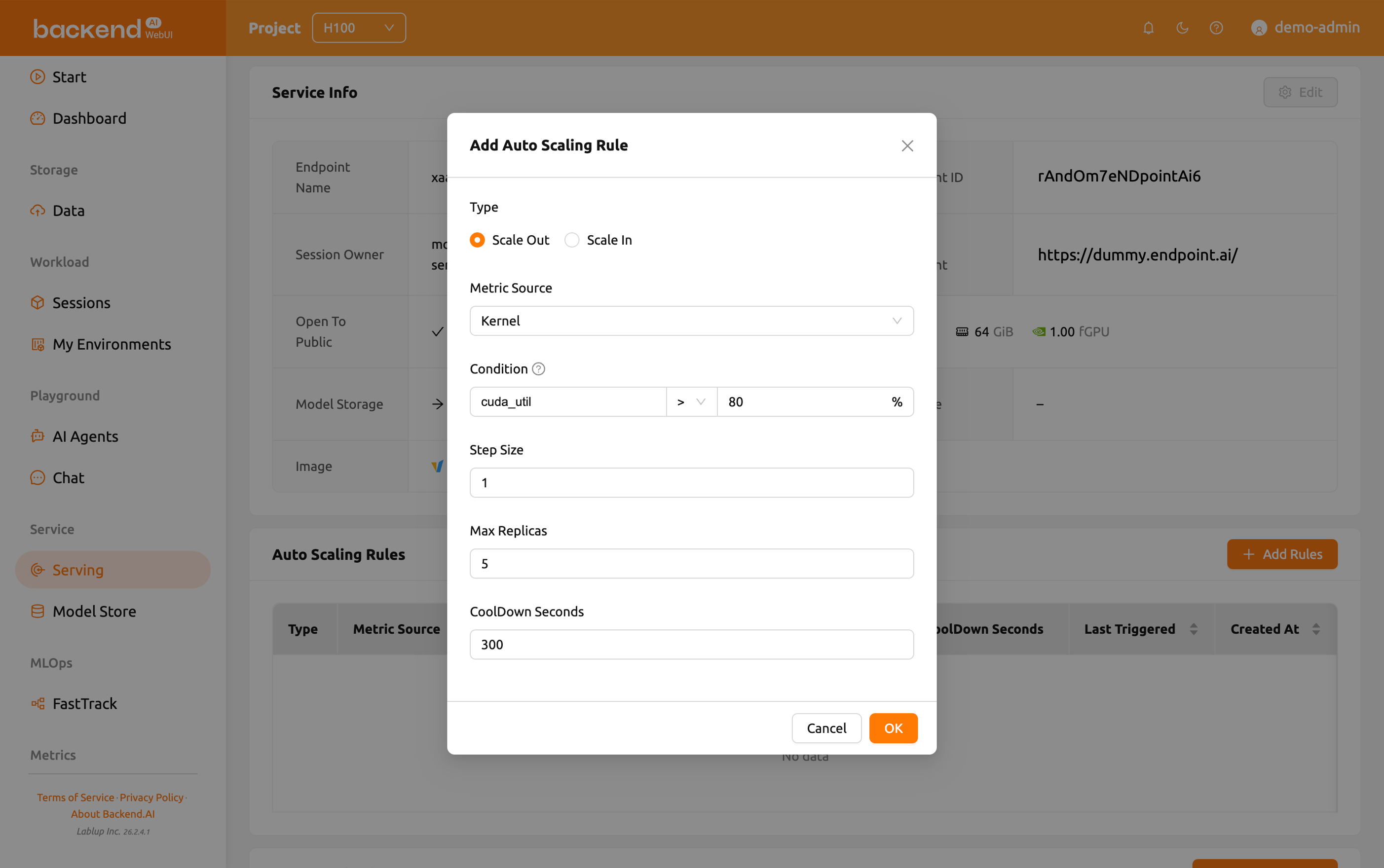

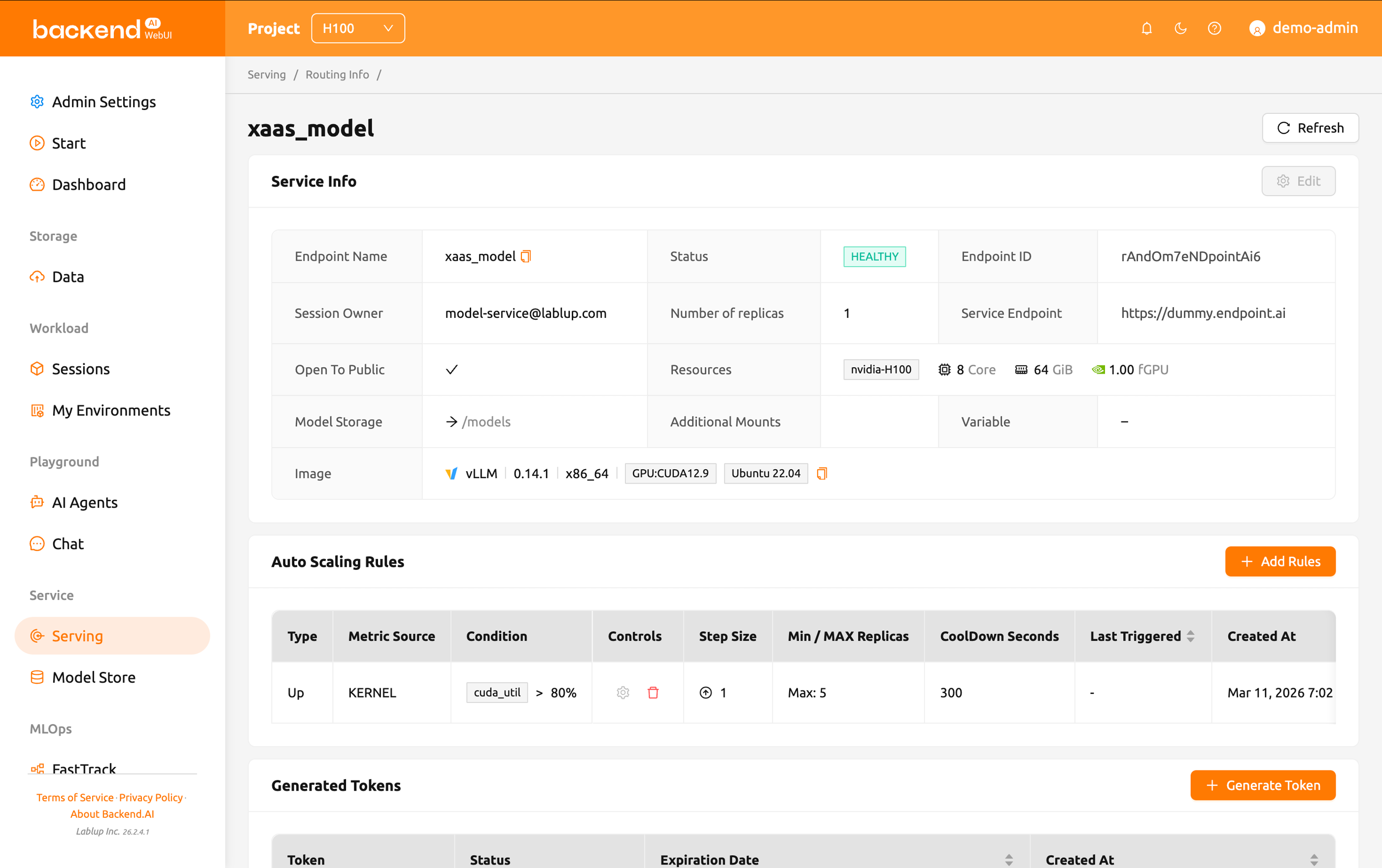

모델을 API 엔드포인트로 배포

학습된 모델을 프로덕션 엔드포인트로 전환하고, 정책 기반으로 자동으로 스케일링할 수 있습니다. Backend.AI에서 학습한 모델을 서빙하기 위해 별도의 다른 소프트웨어를 연결할 필요가 없습니다.

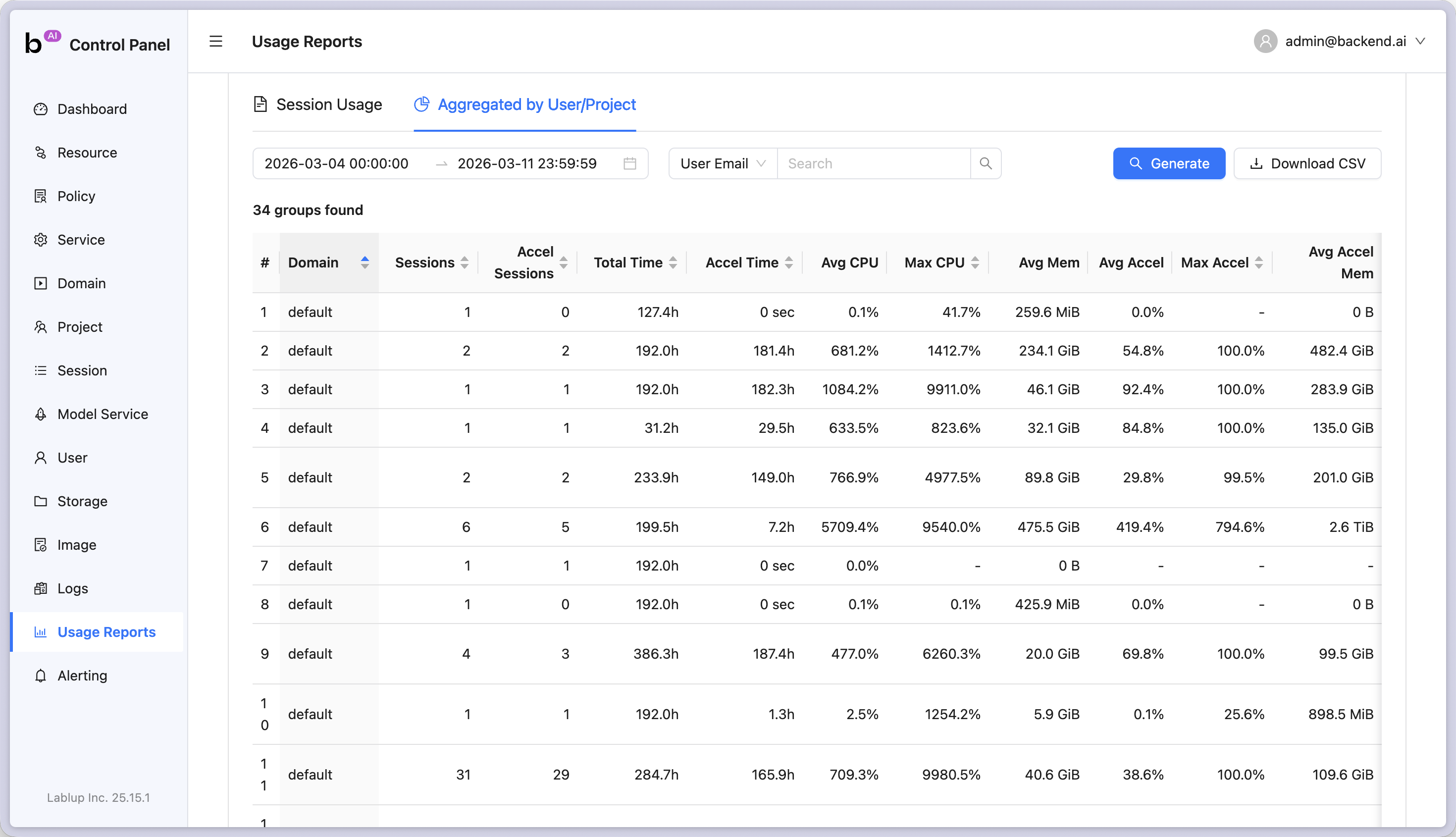

사용량 메트릭과 비용 가시성

팀별, 사용자별 GPU 소비량과 다양한 지표를 시간에 따라 추적합니다. 통계를 활용하여 사용자가 인프라를 효율적으로 활용할 수 있도록 지원합니다.

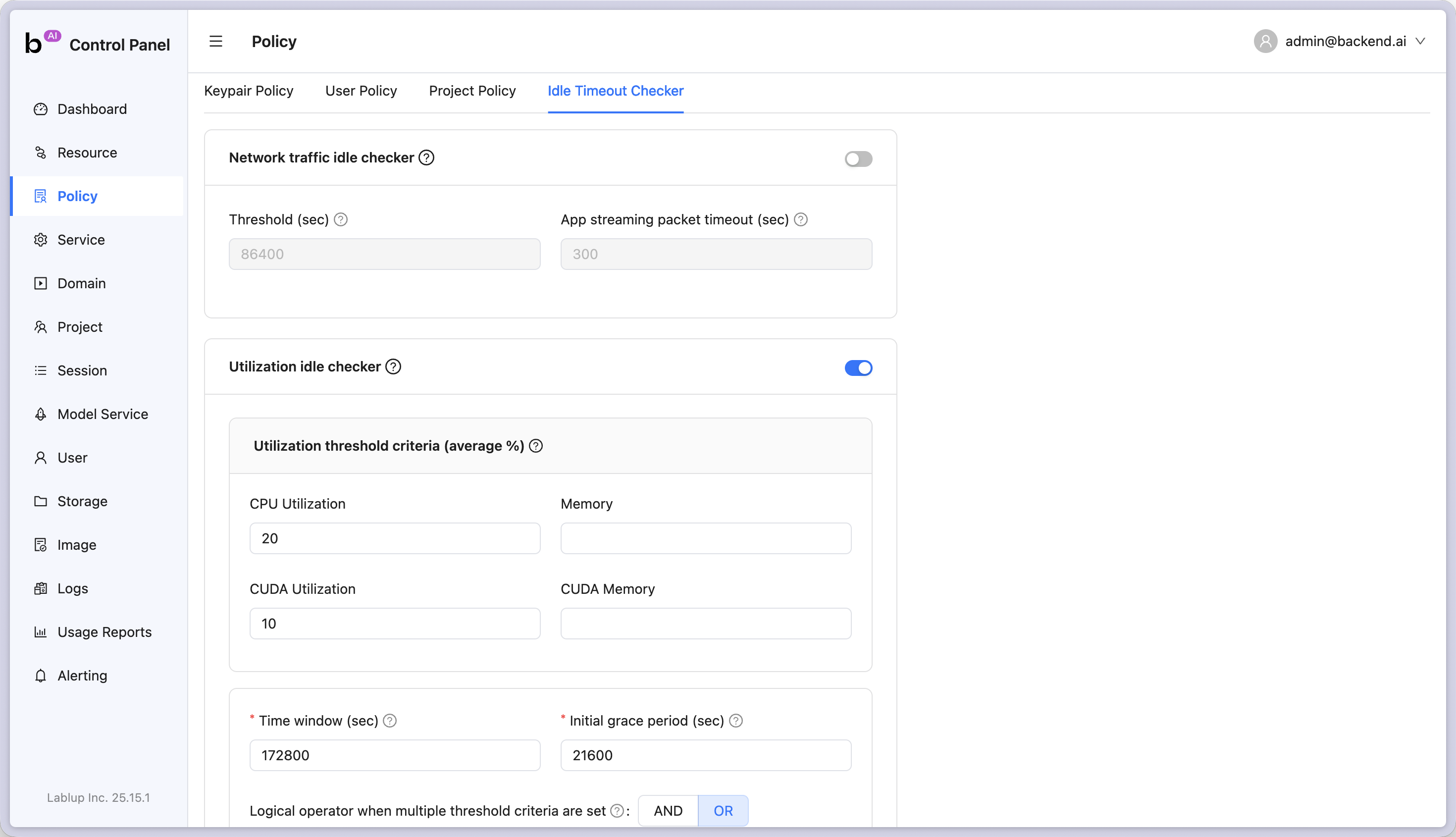

세밀한 정책 제어

조직 관리자를 위한 사용자 관리, 프로젝트 관리, 리소스 관리, 자원 정책 설정, 환경 관리 등 고급 관리 기능을 제공합니다. 엔터프라이즈 고객을 위한 전용 테마 설정과 같은 브랜드 관리 기능도 사용할 수 있습니다.

Who Benefits

역할마다 필요로 하는 모든 것이 하나의 인터페이스에

같은 소프트웨어라도 사용하는 사람에 따라 필요한 기능이 달라집니다. WebUI는 역할에 따라 필요로 하는 화면을 더욱 쉽게 사용할 수 있도록 다양한 사용자층의 목소리를 듣고 개발되었습니다.

정책 기반 자원 관리

팀별 GPU 할당량, 세션 시간 제한, 유휴 자원 회수 정책을 WebUI에서 설정합니다. 정책 변경은 즉시 적용됩니다.

통합 모니터링

클러스터 전체의 GPU 활용률, 노드 상태, 세션 현황을 한 화면에서 실시간으로 파악합니다. 이상 징후는 색상으로 바로 보입니다.

사용자 및 그룹 관리

사용자 등록, 그룹 배정, 역할 부여를 WebUI에서 직접 처리합니다. 감사 로그로 누가 언제 어떤 자원을 사용했는지 추적합니다.

Core Features

WebUI로 할 수 있는 일

GPU 인프라 운영에 필요한 작업을 웹 브라우저 하나로 처리합니다.

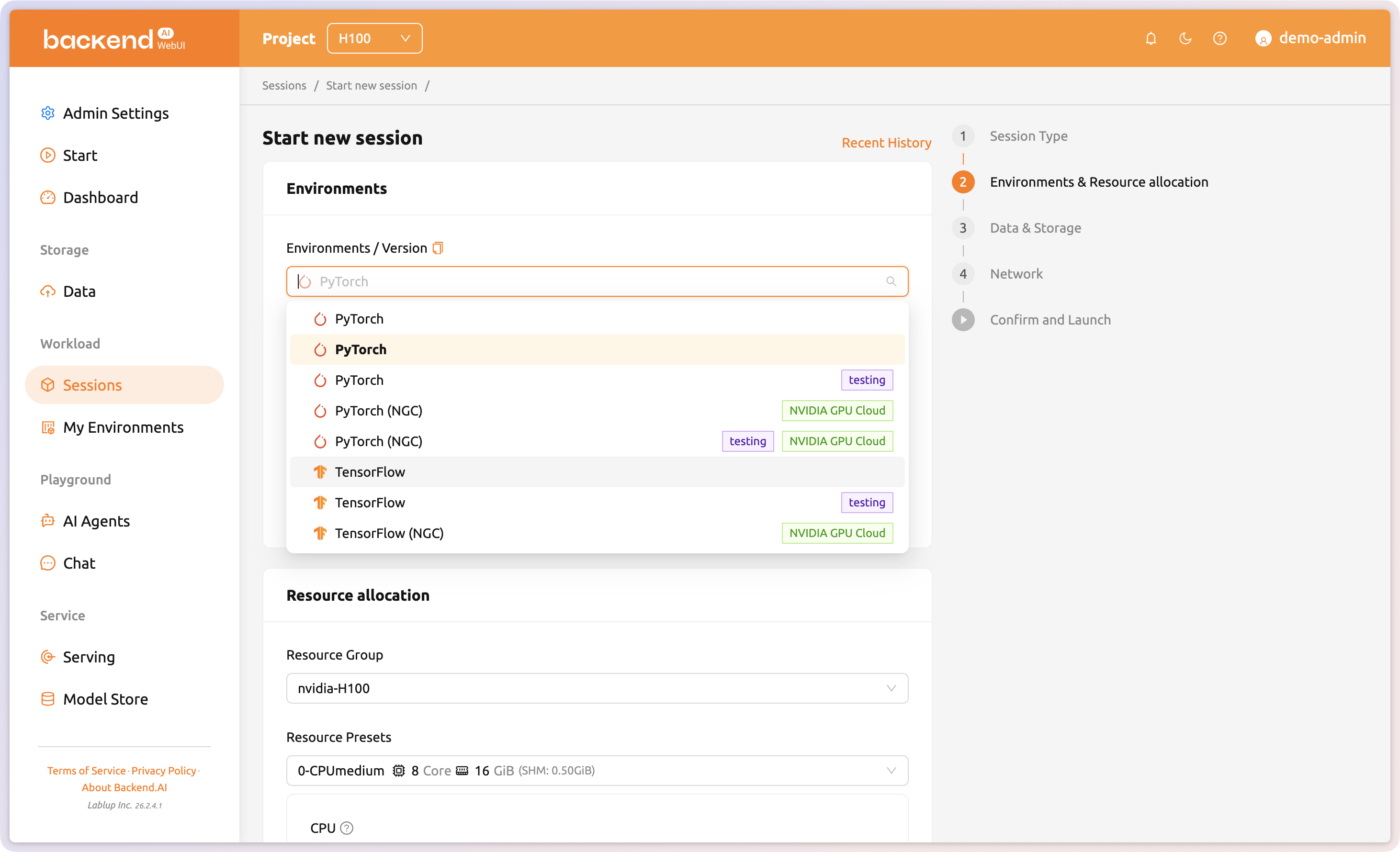

01 — Session-based Workload

프레임워크 종류와 버전을 가리지 않는 자유로운 환경 설정

연구자와 개발자가 세션마다 다른 환경(PyTorch, TensorFlow 등)을 설정할 수 있어, 하나의 GPU 하드웨어 위에서 각자 다른 기반 설정으로 동시에 연구를 수행할 수 있습니다. 이에 따라 연구자들은 별도의 가상환경을 구성할 필요 없이 원하는 환경을 선택하고 세션을 간편하게 시작할 수 있습니다.

02 — Train to Serve

학습에서 추론까지 끊김 없는 하나의 경험

Backend.AI에서 모델을 학습하고, 바로 API 엔드포인트로 배포할 수 있습니다. Interactive 혹은 Batch 세션에서 학습을 완료한 모델을 VFolder에 저장하고, 체크포인트를 서빙 세션에서 바로 불러올 수 있어 실험에서부터 프로덕션까지 하나의 연속된 워크플로우로 구성할 수 있습니다.

03 — Inference Endpoints

확장 가능한 관리형 추론 서비스

모델을 API 엔드포인트로 배포하면 Backend.AI가 트래픽에 따라 자동으로 레플리카를 스케일링합니다. 여러 추론 세션 복제본에 요청을 분배하는 로드밸런싱이 적용되며, 장애 발생 시 세션이 정상 노드로 자동 재배치됩니다. 관리자는 엔드포인트별 자원 사용량을 실시간으로 모니터링하고 스케일링 정책을 설정하여 수동 개입 없이 프로덕션 서비스의 안정성을 유지할 수 있습니다.

04 — Resource Management

정책 기반 자동 자원 할당 및 회수

사용자 또는 프로젝트별로 최대 자원 용량을 설정하면 별도의 승인 없이 할당 범위 내에서 자유롭게 자원을 사용할 수 있습니다. 자원 사용률, 네트워크 활동, 경과 시간 등이 자동으로 모니터링되어 유휴 세션에 할당된 자원은 정책에 따라 회수됩니다.

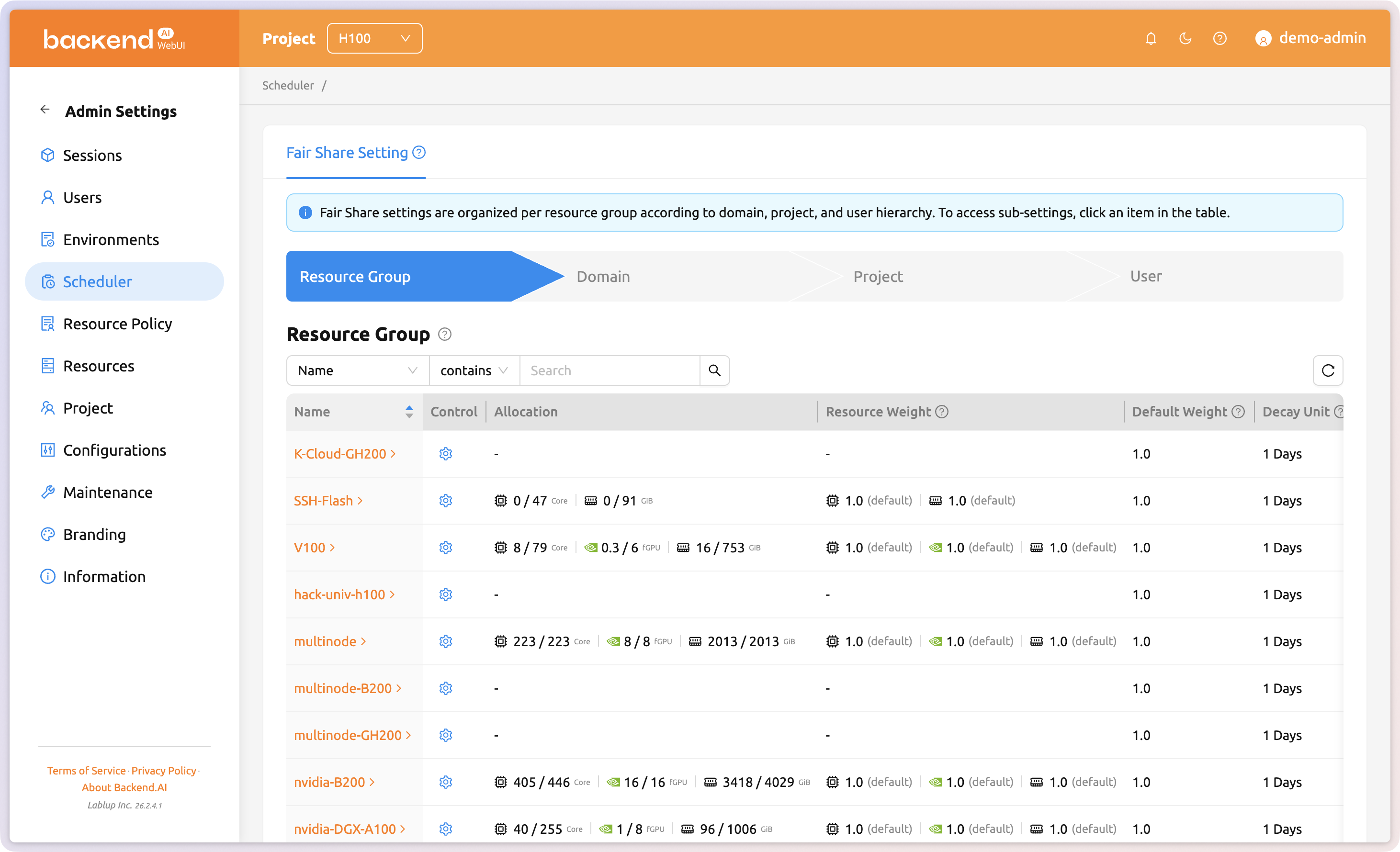

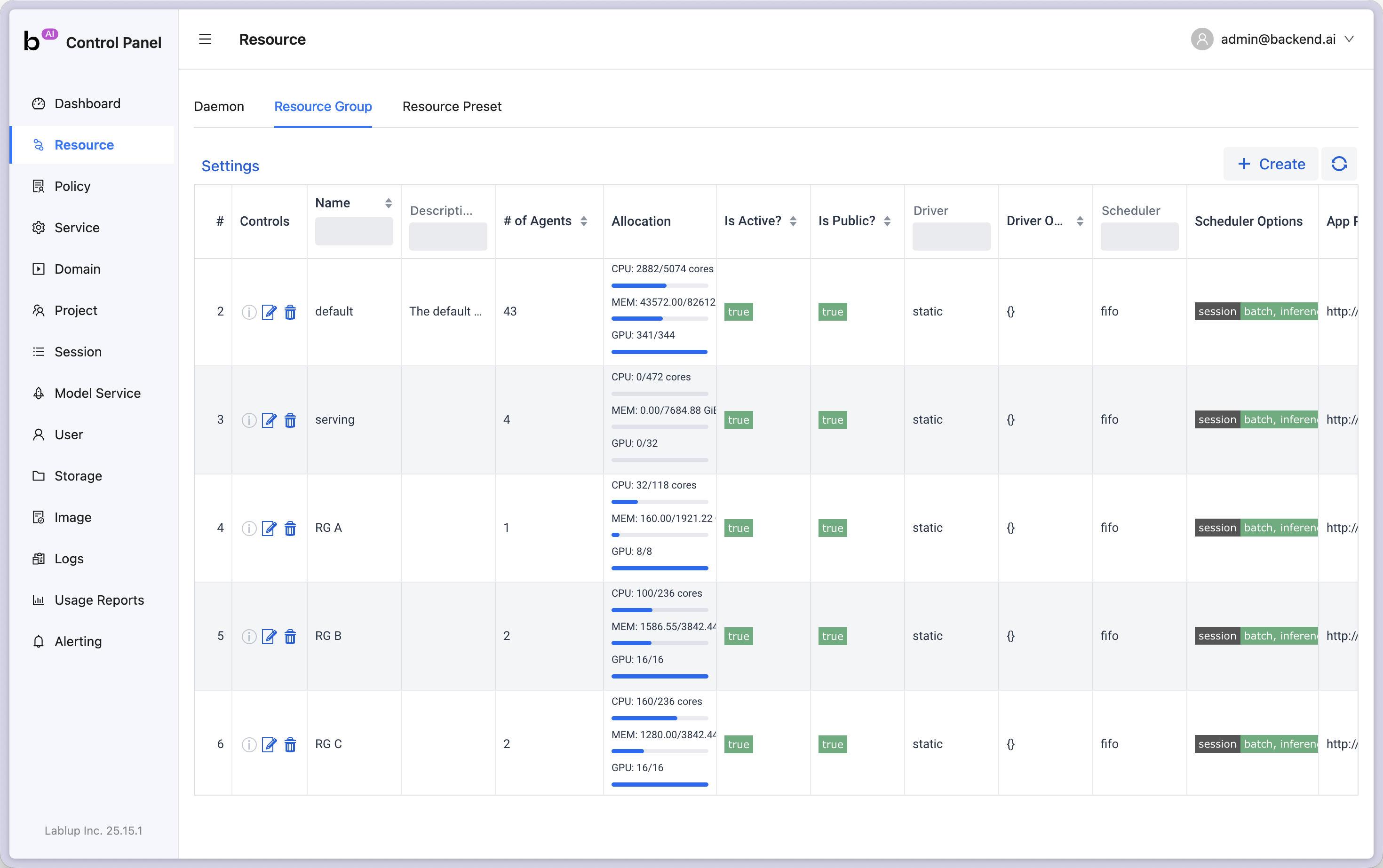

05 — Resource Groups

리소스 그룹 기반의 유연한 자원 관리

하드웨어 자원을 리소스 그룹으로 묶어 사용자, 프로젝트, 도메인별로 할당하면 관리자 개입 없이 정책 범위 내에서 자유롭게 자원을 사용할 수 있습니다. GPU 모델, 워크로드 특징, 노드 종류, 클라우드 제공자 등 다양한 기준으로 노드를 논리적으로 구분하여 팀별 자원 관리와 비용 최적화가 가능합니다.

User Voices

실제 GPU 클러스터를 운영하는 팀들이 선택한 이유

"처음 시작하는 과정이 정말 쉬웠습니다. 제가 예전에 Slurm을 사용해봐서 비교하게 되는데, Slurm은 모든 작업을 CLI 명령어로 입력해야 해서 초기 진입장벽이 높았는데, Backend.AI는 직관적으로 WebUI가 잘 구성되어 있어서 새로운 기능들을 쉽게 탐색하고 바로 사용할 수 있었습니다."

주세환

/엔지니어, 업스테이지

"경영대학 특성상 컴퓨터사이언스 교육을 받은 전담 인력을 배치하기 어려운 특성이 있습니다. 그러나 Backend.AI는 WebUI가 잘 되어 있어서 기존 저희 과 TA 몇 명에게 사용법을 교육했을 때 전반적인 관리가 가능했기 때문에 매우 좋았습니다."

조윤호 교수

/AI, 빅데이터 & 융합경영

GPU 인프라 운영을 위한 더욱 쉬운 방법을 선택하세요

여러분의 인프라를 관리 가능한 자원으로 만들어보세요